Implementando un modelo Challenger de marketing y ventas (1)

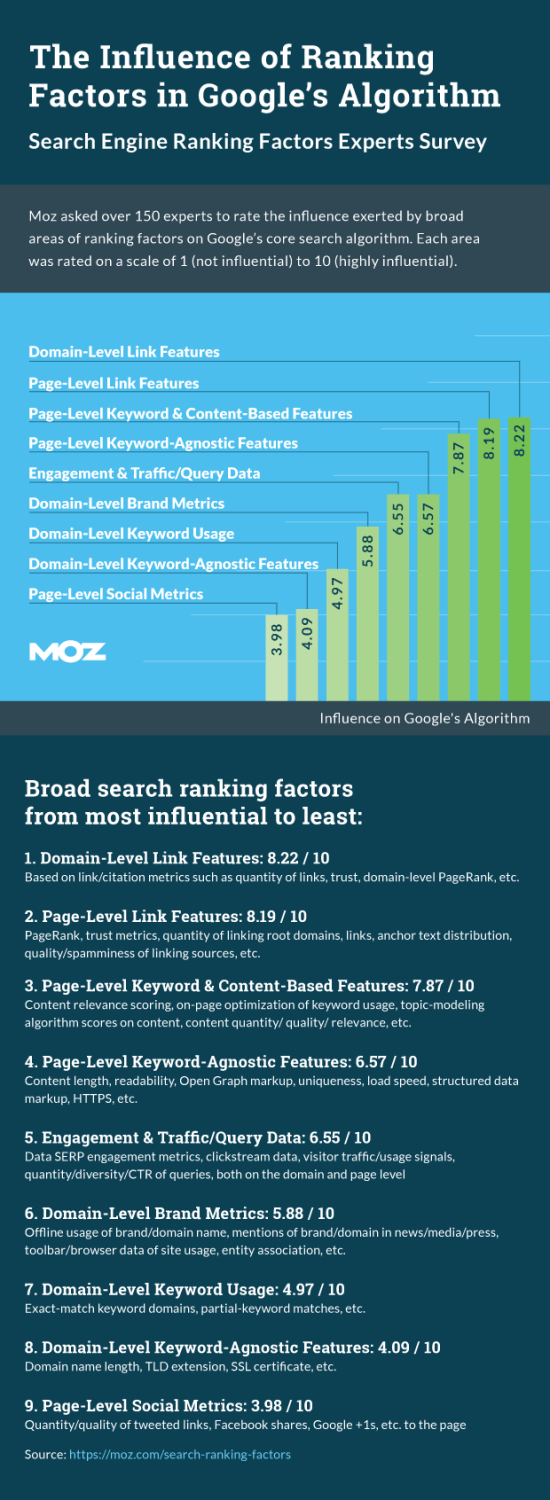

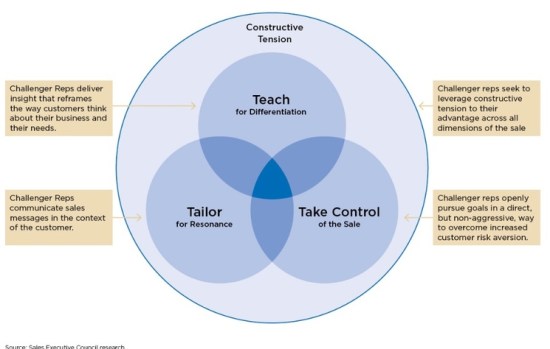

El perfil de vendedor Challenger es el que más éxito tiene en entornos de venta compleja y crisis, y este éxito se debe a una combinación de habilidades: enseñar, adaptar y asumir el control.

En otras ocasiones hemos hablado en este blog del modelo de venta basada en provocación o insights y del nuevo perfil comercial ganador en entornos de venta compleja: el Challenger. Estas ideas provienen en gran medida de un estudio sobre el rendimiento en venta compleja realizado por el Corporate Executive Board (ahora parte de Gartner) en el que analizó a 6.000 comerciales de 83 empresas en diferentes sectores de actividad y que se plasmó en el famoso libro “The Challenger Sale” de M. Dixon y B. Adamson.

Un vendedor Challenger es capaz de aportar a sus clientes ideas y puntos de vista originales sobre su negocio -oportunidades y problemas de los que no eran conscientes- y guiarlos hacia las soluciones que él comercializa, que son las que mejor les pueden habilitar para aprovechar esas oportunidades o resolver esos problemas.

Con ese fin, el Challenger aplica tres habilidades que le sirven para crear una tensión constructiva en el cliente:

Con ese fin, el Challenger aplica tres habilidades que le sirven para crear una tensión constructiva en el cliente:

- Enseñar

- Adaptar

- Asumir el control

En este post vamos a ver en qué consisten y cómo funcionan estas habilidades.

Enseñar para diferenciarse

La característica que realmente distingue a los Challengers es su capacidad para enseñar a los clientes cosas nuevas y valiosas sobre cómo competir en su mercado. En este contexto “enseñar” significa ofrecer a los clientes nuevas perspectivas sobre su negocio (inicialmente no sobre nuestro producto o solución).

Por ejemplo imaginemos un sector donde la práctica generalizada es comprar aplicaciones informáticas best-of-breed optimizadas para cada función. Un proveedor de suites software integradas para ese sector podría revelar a sus clientes que esa práctica en realidad les está costando dinero en términos de funcionalidades redundantes, procesos desintegrados y costes de interoperación.

En las metodologías de venta consultiva, habituales durante los últimos treinta años, hemos aprendido a preguntar para conocer a nuestro cliente tan bien como él mismo. Pero ¿y si el cliente no sabe lo que necesita? En ese caso, más que preguntárselo lo mejor es decirle lo que necesita: en eso consiste la venta basada en insights.

En metodología Challenger a este tipo de enseñanza se le llama Enseñanza Comercial y desde luego no consiste en proporcionar formación gratuita y que el resultado de esta enseñanza, materializado en forma de nuevos proyectos e iniciativas, lo capitalicen otros proveedores. Enseñanza Comercial significa enseñar a los clientes algo valioso sobre SU negocio de modo que lleve a una victoria comercial para NOSOTROS. Para ello sus características son:

- Guía hacia aquellas fortalezas en las que somos únicos. Debe conectarse directamente hacia aquellas características en las que somos superiores a los competidores. Ello requiere descubrir oportunidades para el cliente, estar seguros de que podemos ayudar y conocer nuestras fortalezas únicas.

- Desafía las asunciones de los clientes. Debe hablar directamente a su mundo de una forma en la que no habían pensado o no habían descubierto: se trata de “reformular” o “reencuadrar” (en inglés, reframe) la forma en la que piensan sobre su negocio, no confirmar o validar sus conceptos previos. Para ser capaces de ofrecer una reformulación hay que conocer el negocio del cliente mejor que él mismo… al menos en la parte de éste que tiene que ver con nuestra área de solución. Si ante nuestro intento de reformulación el cliente responde con una reacción del tipo “Estoy totalmente de acuerdo”, aunque sea un resultado aparentemente favorable en realidad no lo es porque significa que no le hemos enseñado nada, sino que le hemos mostrado cosas que él ya conocía. Se trata de reformular, NO de “sintonizar”: hay que buscar una reacción del tipo “Nunca había pensado en ello de esa manera”.

- Cataliza la acción. Hay que ayudar a los clientes a entender los costes en los que están incurriendo o los ingresos a los que están renunciando por no actuar sobre la oportunidad que les hemos enseñado. Más que nada hay que conseguir que deseen perseguir el reframe (aunque inicialmente no insistamos en posicionar nuestros productos). Antes de comprar nada necesitan entender en qué les beneficia resolver el problema.

- Escalar a través de los clientes. Para que el proceso escale hay que desplegar el proceso segmento a segmento, no cliente a cliente. Para ello hay que utilizar una segmentación basada en necesidades y realizar un desarrollo de insights a nivel de empresa, donde poseemos las capacidades y la variedad de insights necesaria, no a nivel de vendedor.

En el próximo post profundizaremos en esta habilidad clave de los Challenger.

Adaptar para sintonizar

La capacidad para adaptar el mensaje a diferentes tipos de clientes –y de diferentes individuos dentro de la organización cliente– es lo que hace que el mensaje cale y perdure en el cliente. La tendencia a vender soluciones más complejas y la crisis económica han provocado el auge de la compra por consenso (la necesidad de tener a una gran parte de la organización de acuerdo antes de avanzar), lo que ha aumentado el número y variedad de involucrados en la compra.

La adaptación del mensaje se puede hacer a nivel de sector, empresa, rol e individuo. Las personas (arquetipos) centradas en los diferentes roles de participantes en el proceso de compra, y que incorporen sus respectivos objetivos, resultados deseados, área de foco, preocupaciones, drivers de valor, etc. nos pueden ayudar a sistematizar esta adaptación. Después se pueden desarrollar argumentarios para posicionar y demostrar el valor de nuestra solución para cada una de esas personas.

Asumir el control de la venta

Los Challengers poseen la capacidad para reivindicar y mantener el control sobre la venta. Ser asertivo no significa ser agresivo y mucho menos molesto o abusivo. Tiene que ver con la disposición y la habilidad del vendedor para mantener su posición cuando el cliente ofrece resistencia o le empuja a retroceder. Esta asertividad suele tomar dos formas: controlar la discusión sobre precios y dinero y presionar el proceso de toma de decisiones del cliente para llegar a una decisión más rápidamente y superar la “inercia de la indecisión”. Los Challengers están más cómodos hablando de dinero y son capaces de “empujar” al cliente. Tienen capacidad para demostrar y afianzarse en el valor de sus soluciones y para mantener el empuje a través de todo el proceso. Estas habilidades están sustentadas por la confianza en el valor superior que van a proporcionar al cliente. También crean impulso en el proceso: siempre piensan y buscan consenso sobre los siguientes pasos.

- Asumir el control no es negociar: en realidad es algo que ocurre desde el principio del proceso, cuando el vendedor busca expandir su acceso dentro de la organización cliente y entender las motivaciones y objetivos de todos los involucrados en el proceso.

- Asumir el control no es solo respecto a asuntos de dinero: por supuesto que pueden “empujar” al cliente en términos de dinero y en el avance del proceso, pero lo más importante es que lo asumen respecto a las ideas, cambiando al manera de pensar que los clientes tienen sobre su negocio y sus retos.

- Asumir el control no es ser agresivo: es ser asertivo, usar lenguaje directo pero no intimidante ni ofensivo, perseguir sus objetivos de una manera constructiva, con respeto y sensibilidad sobre cómo reacciona la otra parte.

¿Y cuál de estas habilidades es la más importante? Pues en realidad es la combinación de habilidades lo que importa. Estas tres habilidades son como las tres patas de un taburete: si falla alguna de ellas la construcción no se mantiene. Si enseñamos sin adaptar podemos caer en la irrelevancia, si adaptamos sin enseñar podemos ser indiferenciados, si controlamos sin aportar insights podemos resultar molestos. Es su aplicación sinérgica la que confiere al Challenger su ventaja.

En el próximo post hablaremos de cómo articular una conversación dirigida por insights y de cómo cambiar la organización para implementar un modelo Challenger.

El post “Implementando un modelo Challenger de marketing y ventas (1)” se publicó primero en “Marketing & Innovación”.

[¿Quieres aprender a aplicar estas ideas en tu empresa? Nuestros talleres sobre Venta de productos tecnológicos y Marketing estratégico para empresas tecnológicas te pueden ayudar.]

Las herramientas de automatización de marketing permiten hacer un scoring de leads basado en su “lenguaje corporal digital”. Los leads que muestran actividad con los emails y los sitios web de la empresa tienen una alta puntuación y se envían a ventas. Típicamente este scoring consiste en sumar una puntuación predeterminada por cada actividad del prospect (ej., descargarse un white paper) y tiene poco poder predictivo.

Las herramientas de automatización de marketing permiten hacer un scoring de leads basado en su “lenguaje corporal digital”. Los leads que muestran actividad con los emails y los sitios web de la empresa tienen una alta puntuación y se envían a ventas. Típicamente este scoring consiste en sumar una puntuación predeterminada por cada actividad del prospect (ej., descargarse un white paper) y tiene poco poder predictivo. En el

En el  Más recientemente la publicidad digital, con sus enormes posibilidades de medida y control, prometió relegar esa frase a la historia. Las nuevas técnicas de publicidad display, especialmente la publicidad programática, iban a permitir entregar a cada usuario el anuncio más enfocado y relevante en cada momento, en unos procesos totalmente trazables que harían posible evaluar los resultados de cada campaña y reducir los temores de Wanamaker a algo sin fundamento.

Más recientemente la publicidad digital, con sus enormes posibilidades de medida y control, prometió relegar esa frase a la historia. Las nuevas técnicas de publicidad display, especialmente la publicidad programática, iban a permitir entregar a cada usuario el anuncio más enfocado y relevante en cada momento, en unos procesos totalmente trazables que harían posible evaluar los resultados de cada campaña y reducir los temores de Wanamaker a algo sin fundamento.